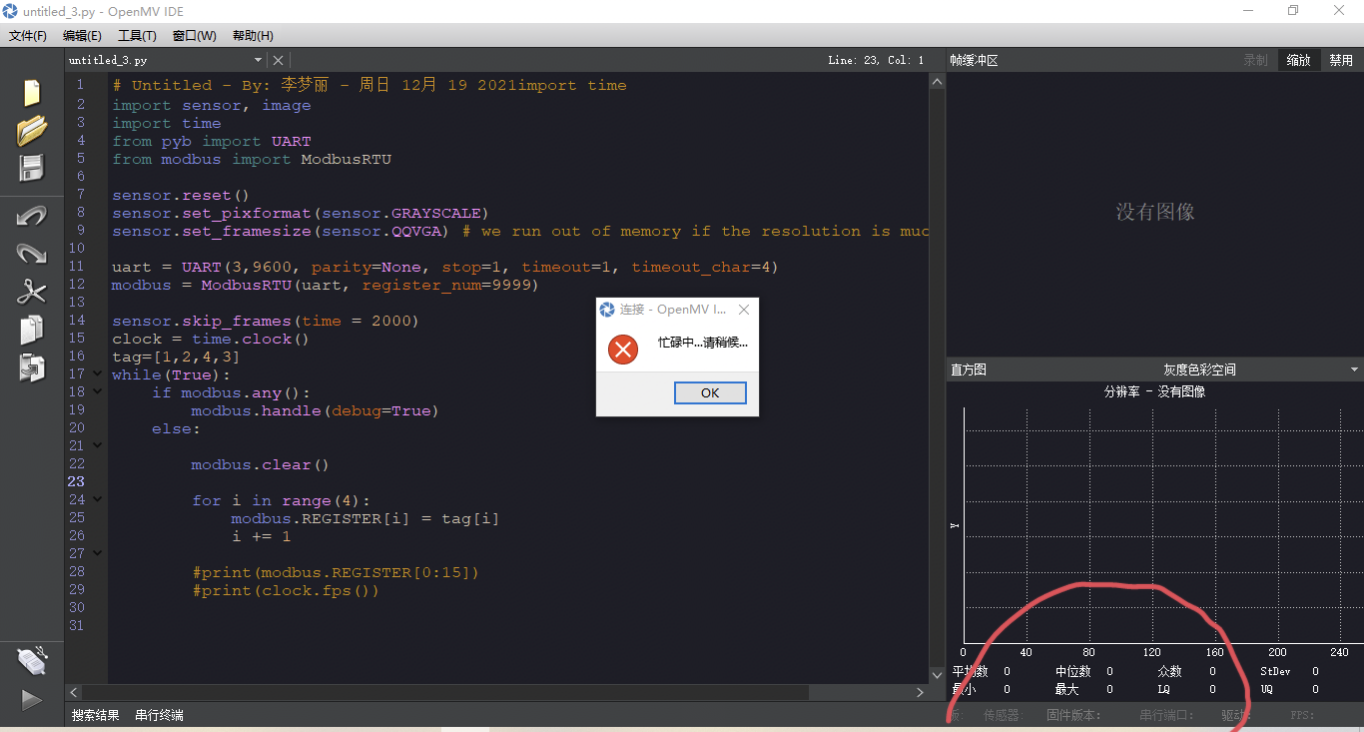

openmv4h7plus连接不上,试了更新固件也没办法更新,要怎么解决?

upe4 发布的帖子

-

请问openmv4 h7plus是一个32位的系统,它可以运行被量化为int8的神经网络模型吗发布在 OpenMV Cam

请问openmv4 h7plus是一个32位的系统,它可以运行被量化为int8的神经网络模型吗?

-

RE: 请问想用openmv4plus的usart实现基于Modbus协议的串行通信,是不是需要增加一个TTL转RS485模块?发布在 OpenMV Cam

你好,是想要openmv与电脑进行通信,是不是只需要增加一个TTL转RS485模块就可以了?openmv是只有TTL串口吗?

-

请问想用openmv4plus的usart实现基于Modbus协议的串行通信,是不是需要增加一个TTL转RS485模块?发布在 OpenMV Cam

请问想用openmv4plus的usart实现基于Modbus协议的串行通信,是不是需要增加一个TTL转RS485模块?openmv是只有TTL串口吗?想问下能否在脱机运行下实现基于Modbus协议的串行通信?

-

请问openmv4H7Plus电路板外置的32MB的SDRAM和32MB的QSPI Flash分别用来存储什么呢?发布在 OpenMV Cam

请问openmv4H7Plus电路板外置的32MB的SDRAM和32MB的QSPI Flash分别用来存储什么呢?资源是怎么分配的?

-

sensor.set_lens_correction这个函数的源代码具体在哪呢?发布在 OpenMV Cam

sensor.set_lens_correction请问这个畸变校正函数的源代码具体在哪呢?为什么在github上找不到?

-

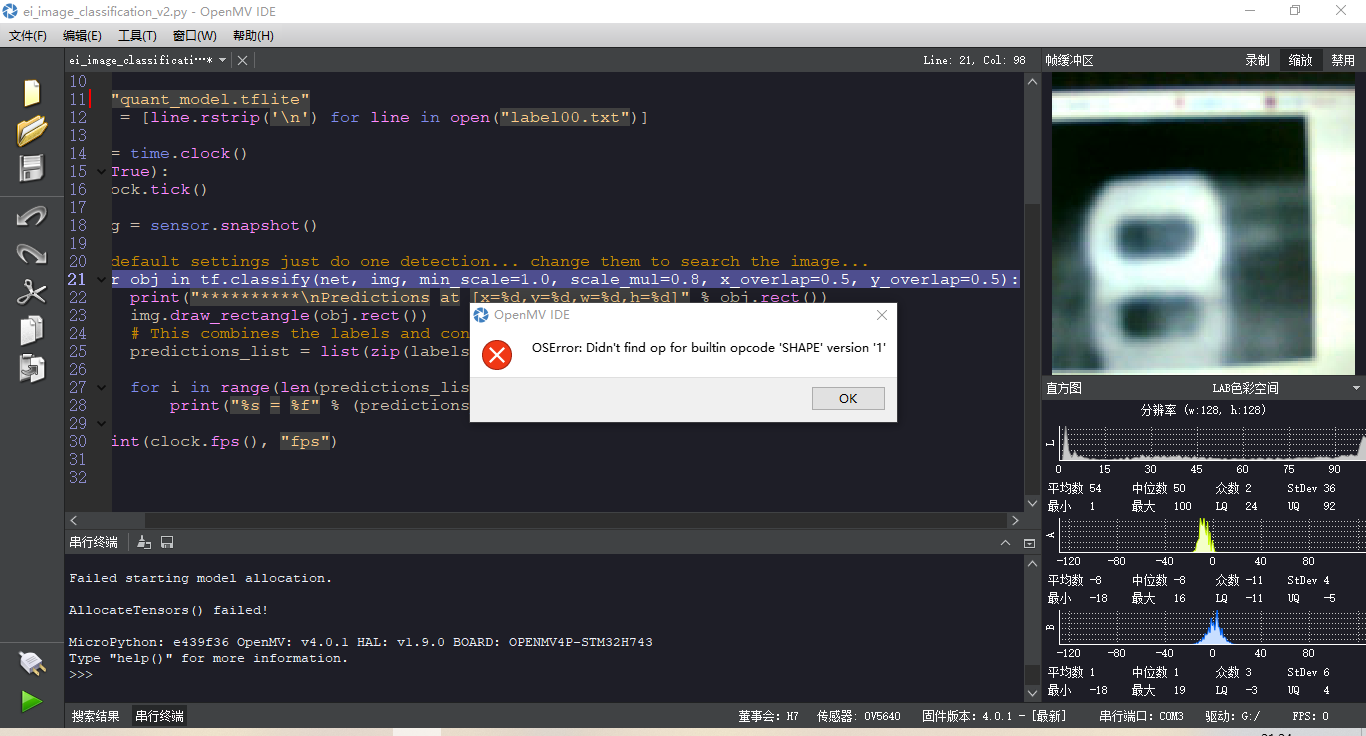

在TF2上训练神经网络生成的tflite模型在pc端测试时分类结果正确,部署到openmv无法正确分类?发布在 OpenMV Cam

为什么在tensorflow上训练的mobilenetv2网络生成的tflite模型在片pc端测试时能够正确实现图像分类,但部署到openmv之后无法正确分类?

import sensor, image, time, os, tf sensor.reset() # Reset and initialize the sensor. sensor.set_pixformat(sensor.RGB565) # Set pixel format to RGB565 (or GRAYSCALE) sensor.set_framesize(sensor.QVGA) # Set frame size to QVGA (320x240) sensor.set_windowing((64, 64)) # Set 240x240 window. sensor.skip_frames(time=2000) # Let the camera adjust. net = "model1_e.tflite" labels = [line.rstrip('\n') for line in open("labels_all.txt")] clock = time.clock() #while(True): #clock.tick() img = sensor.snapshot() #img = ((img / 255) - 0.5) * 2.0 # default settings just do one detection... change them to search the image... for obj in tf.classify(net, img, min_scale=1.0, scale_mul=0.8, x_overlap=0.5, y_overlap=0.5): print("**********\nPredictions at [x=%d,y=%d,w=%d,h=%d]" % obj.rect()) img.draw_rectangle(obj.rect()) # This combines the labels and confidence values into a list of tuples predictions_list = list(zip(labels, obj.output())) for i in range(len(predictions_list)): print("%s = %f" % (predictions_list[i][0], predictions_list[i][1])) print(clock.fps(), "fps") -

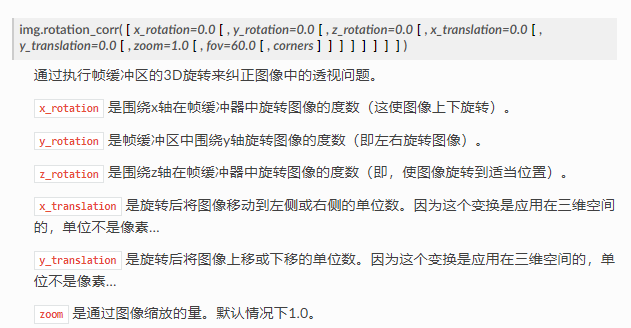

请问如果拍摄角度是倾斜的,不固定的,但是在不改变拍摄角度的情况下怎么去对倾斜校正呢?发布在 OpenMV Cam

我在做一个图像倾斜校正的实验,如图,图像存在一点倾斜的情况。请问如何在拍摄角度存在倾斜的情况下,不改变拍摄角度对图像进行倾斜校正呢?

-

为什么自己训练的mobilenetv1网络模型部署到openmv上会出现这个错误?发布在 OpenMV Cam

自己在TensorFlow框架下训练了mobilenetv1网络模型转为tflite模型后部署到openmv上出现了这种报错,是什么原因呢? -

RE: 在TensorFlow下用自己的数据集训练mobilenetv2网络,转成tflite模型部署openmv上不能用发布在 OpenMV Cam

应该不是v1v2的问题吧,edgeimpulse在线训练的不是也能用v2吗?请问转成tflite模型部署到openmv有什么需要注意的吗?或者有特定的转换方法吗?因为我转换之后是能在openmv上跑的,就是准确率和在PC上测试的不一样,在openmv上他只识别成一个结果

-

在TensorFlow下用自己的数据集训练mobilenetv2网络,转成tflite模型部署openmv上不能用发布在 OpenMV Cam

请问为什么自己在pc上用自己的数据集训练了mobilenetv2模型,并转换成立了tflite模型,部署到openmv上能跑,但是识别结果不对,它表现为无论测试什么图片,识别结果都是那一个,不会改变,但是在pc上测试的准确率明明是99%,想问下是什么原因?

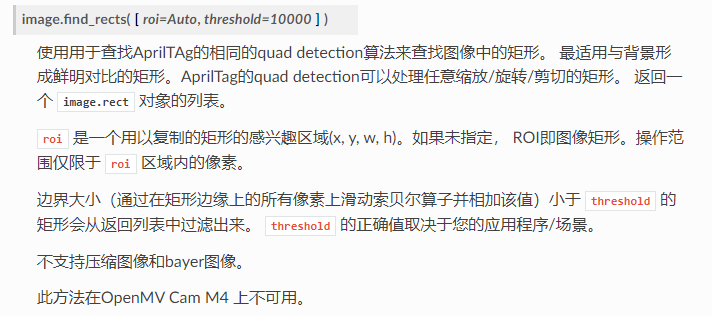

![0_1638161973676_{%$HI4$UR[2W9P5Z2]1A7HS.png](https://fcdn.singtown.com/2935afbe-4e3b-48aa-b916-fccf2fca5137.png) 请问这个函数源码在哪呢?找了很多没找到

请问这个函数源码在哪呢?找了很多没找到