@kidswong999 明白你的意思了,但积分是指识别出来的置信度嘛,我应该如何获取呢

P

pyni 发布的帖子

-

使用fomo模型的问题发布在 OpenMV Cam

使用fomo模型后,如果有多个目标,如何使openmv先检测任何 “一个” 目标!

我直接使用了detection数组的第0位,但目标点容易晃动(也有可能是模型不准确,背景产生的影响),如下图所示

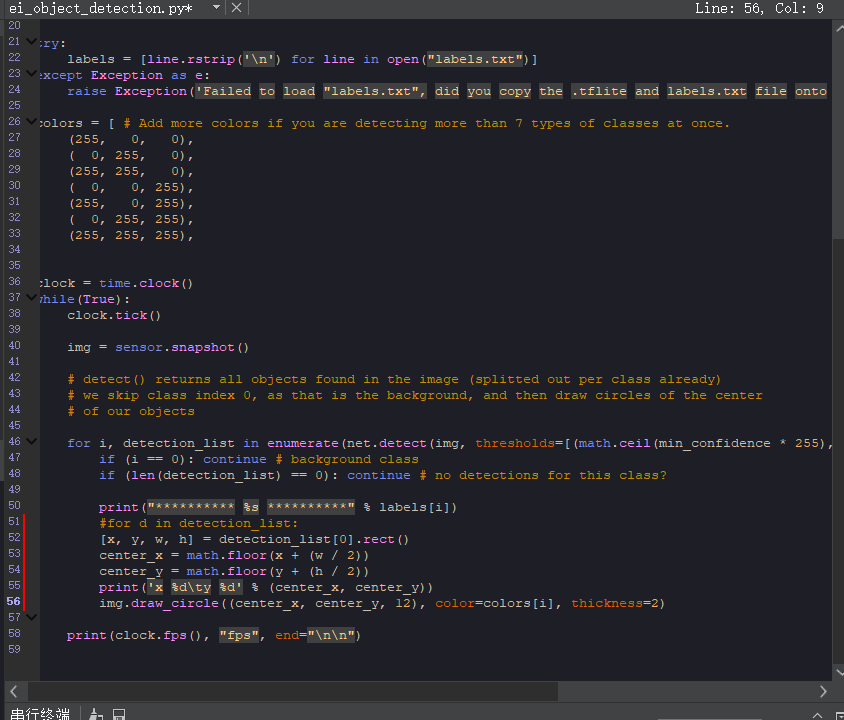

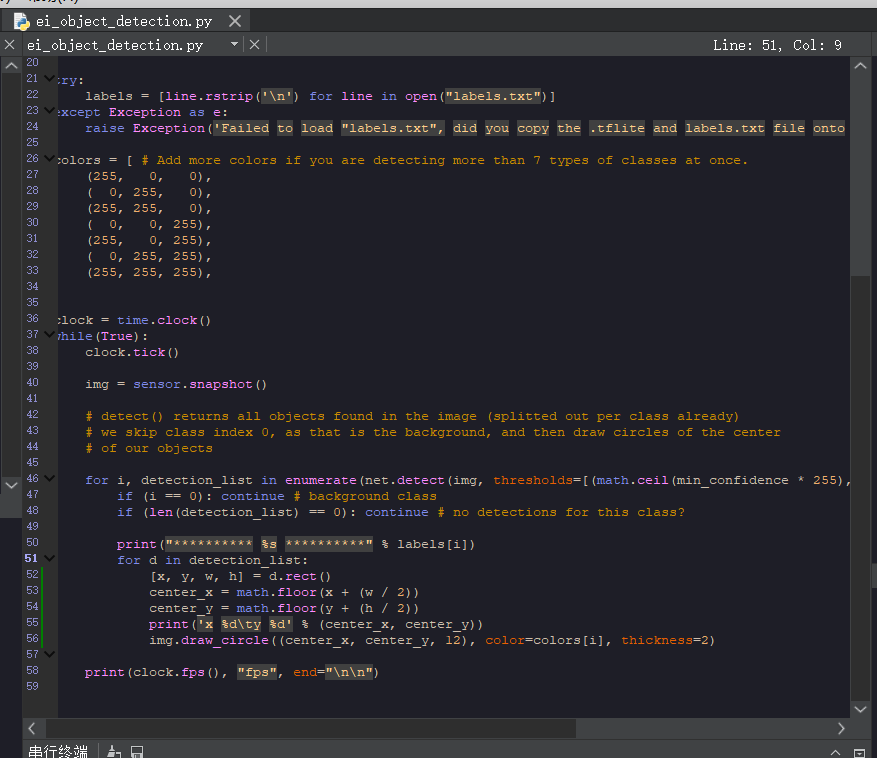

原生成代码为

请问有无更好的方法,谢谢

-

关于如何获得openmv拍照后像素点数据的问题发布在 OpenMV Cam

在openmv ide中,使用img = sensor.snapshot()函数可以截图保存当前照片作为对象。想请问在使用img = sensor.snapshot()函数后,我能否通过通过某些语句去获得这张照片的所有像素点数据,如rgb565等数据。我们的目的想通过获取整张图片的所有像素数据显示在某个lcd屏幕上而不是openmv自身所带的lcd,希望可以帮忙解答,谢谢

-

RE: openmv能够识别塑料瓶子并返回其在图像中的坐标吗发布在 OpenMV Cam

@kidswong999 找到了,create impulse学习时将迁移学习变为object detection

-

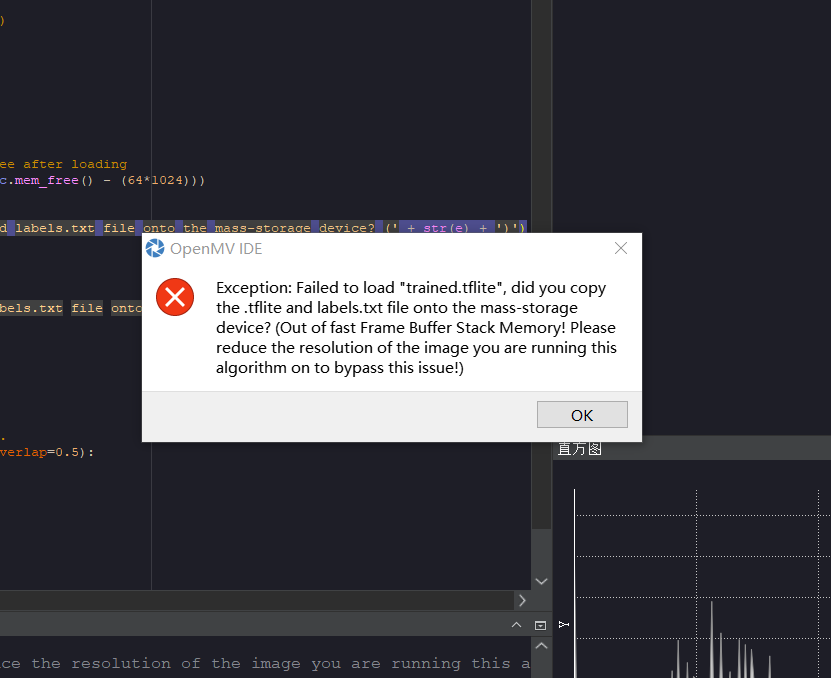

进行模型训练的时候出现了Fail to load " trained.tflite "....,出现此类问题的原因是??发布在 OpenMV Cam

# Edge Impulse - OpenMV Image Classification Example import sensor, image, time, os, tf, uos, gc sensor.reset() # Reset and initialize the sensor. sensor.set_pixformat(sensor.RGB565) # Set pixel format to RGB565 (or GRAYSCALE) sensor.set_framesize(sensor.QQVGA) # Set frame size to QVGA (320x240) sensor.set_windowing((240, 240)) # Set 240x240 window. sensor.skip_frames(time=2000) # Let the camera adjust. net = None labels = None try: # load the model, alloc the model file on the heap if we have at least 64K free after loading net = tf.load("trained.tflite", load_to_fb=uos.stat('trained.tflite')[6] > (gc.mem_free() - (64*1024))) except Exception as e: print(e) raise Exception('Failed to load "trained.tflite", did you copy the .tflite and labels.txt file onto the mass-storage device? (' + str(e) + ')') try: labels = [line.rstrip('\n') for line in open("labels.txt")] except Exception as e: raise Exception('Failed to load "labels.txt", did you copy the .tflite and labels.txt file onto the mass-storage device? (' + str(e) + ')') clock = time.clock() while(True): clock.tick() img = sensor.snapshot() # default settings just do one detection... change them to search the image... for obj in net.classify(img, min_scale=1.0, scale_mul=0.8, x_overlap=0.5, y_overlap=0.5): print("**********\nPredictions at [x=%d,y=%d,w=%d,h=%d]" % obj.rect()) img.draw_rectangle(obj.rect()) # This combines the labels and confidence values into a list of tuples predictions_list = list(zip(labels, obj.output())) for i in range(len(predictions_list)): print("%s = %f" % (predictions_list[i][0], predictions_list[i][1])) print(clock.fps(), "fps")