@kidswong999 谢谢大咖

5hpe 发布的帖子

-

P1输入口常为“1”无法改变发布在 OpenMV Cam

为什么我定义的P1输入口,它的value一直是“1”,不管是否用P1接触VIN:

sensor.reset() sensor.set_pixformat(sensor.RGB565) sensor.set_framesize(sensor.QVGA) sensor.skip_frames(20) p1_in = Pin('P1', Pin.IN, Pin.PULL_NONE) value1 = p1_in.value() while(True): img = sensor.snapshot() if value1 == 1: led = pyb.LED(2) led.off() led = pyb.LED(1) led.on() time.sleep(1) led.off() print(value1) else: led = pyb.LED(2) led.on() print(value1)

-

openmv plus输入信号选取发布在 OpenMV Cam

是否能够将"vin"、"3.3V"接通至P0-P9或者其他口作为输入信号,如果可以,代码使用:

p1_in = Pin('P1', Pin.IN)

还是需要加上PULL UP / PULL DOWN -

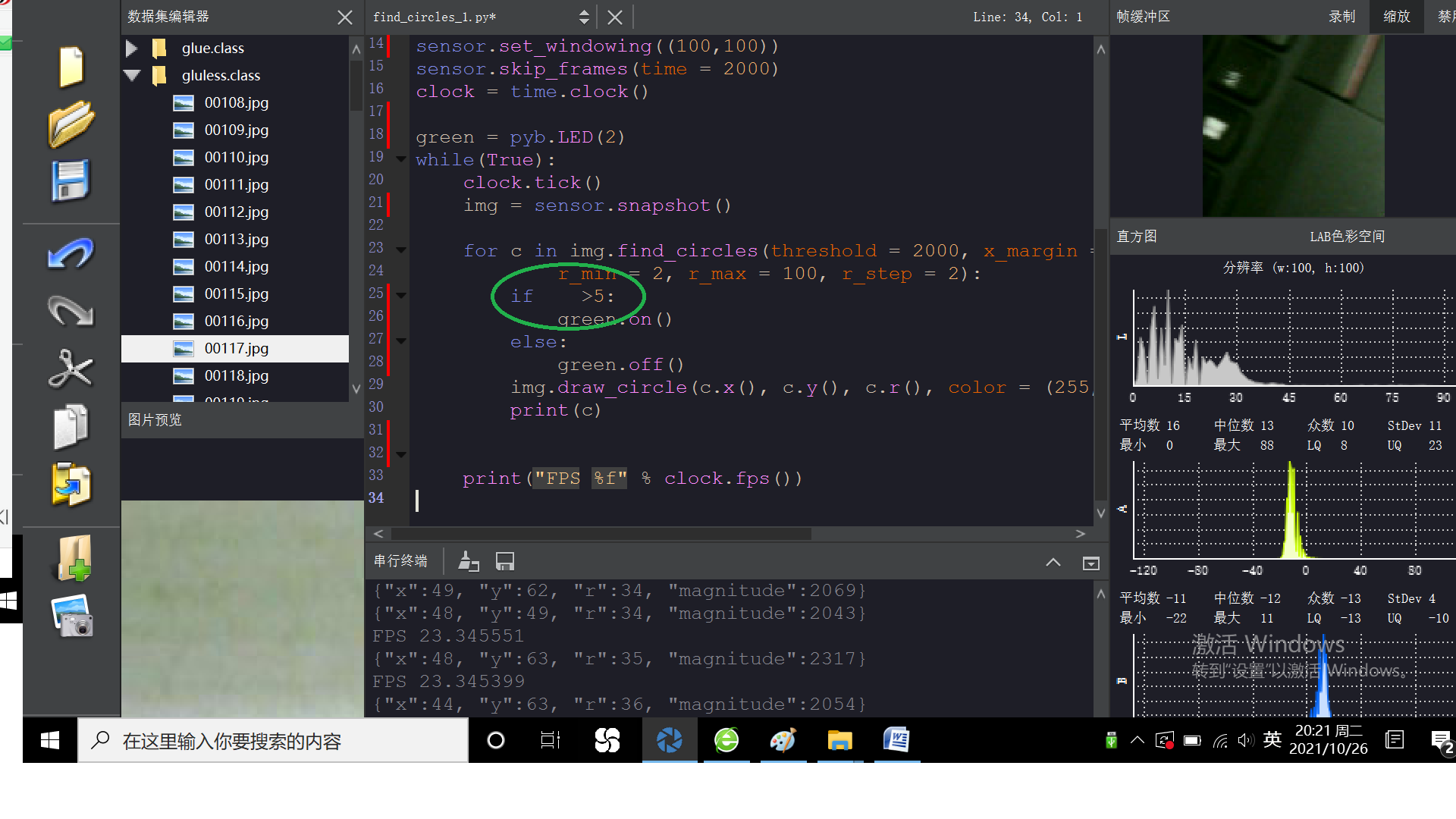

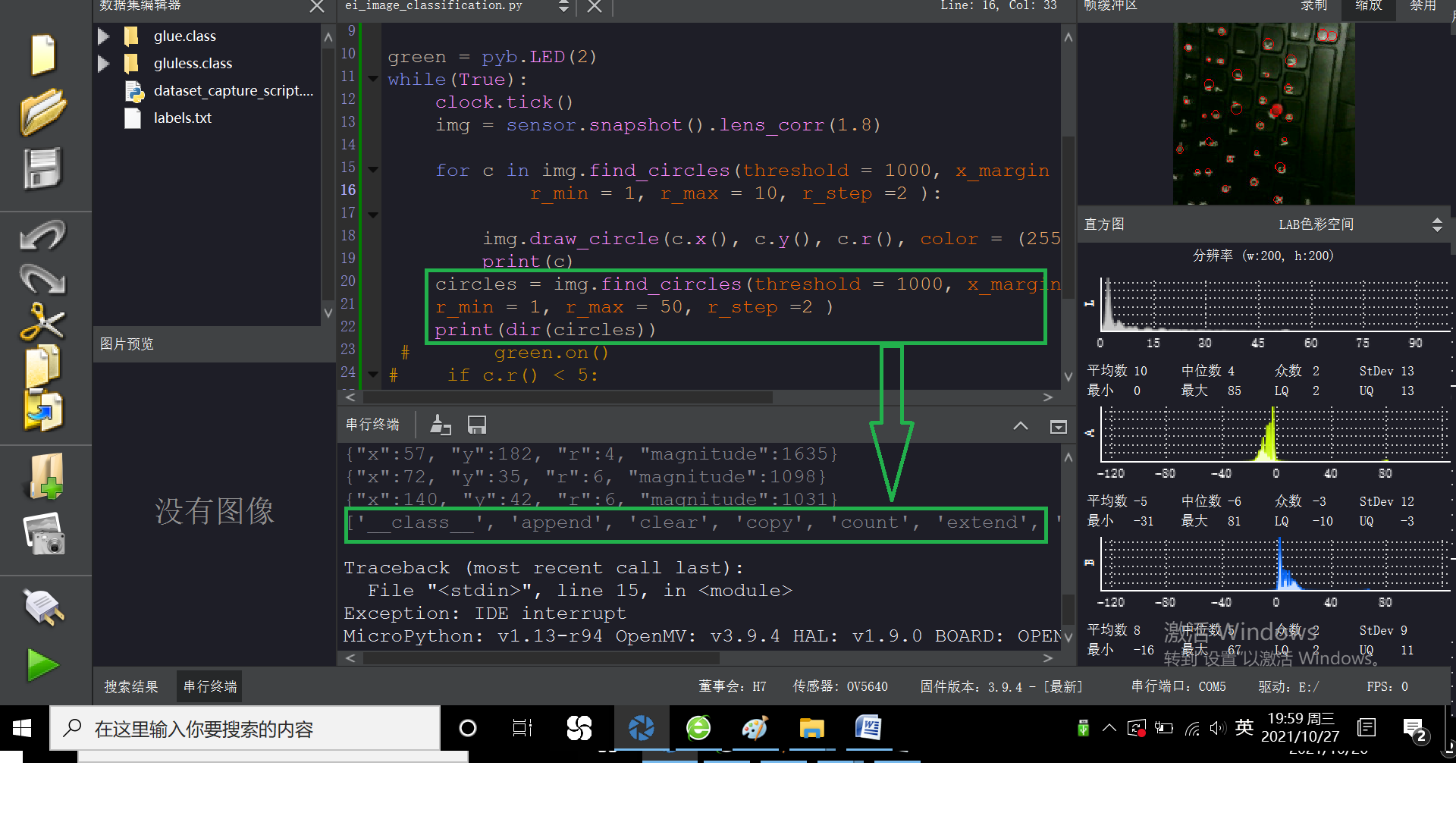

寻找圆数量,查了您以前答疑的代码发布在 OpenMV Cam

查了您以前答疑的代码:

一堆圆 = img.find_circles(xxxxxxx)一堆圆就是一个列表

print(dir(一堆圆))#打印 一堆圆的 数量,比如5

但是为什么没有打印数量,而是下面这一串

-

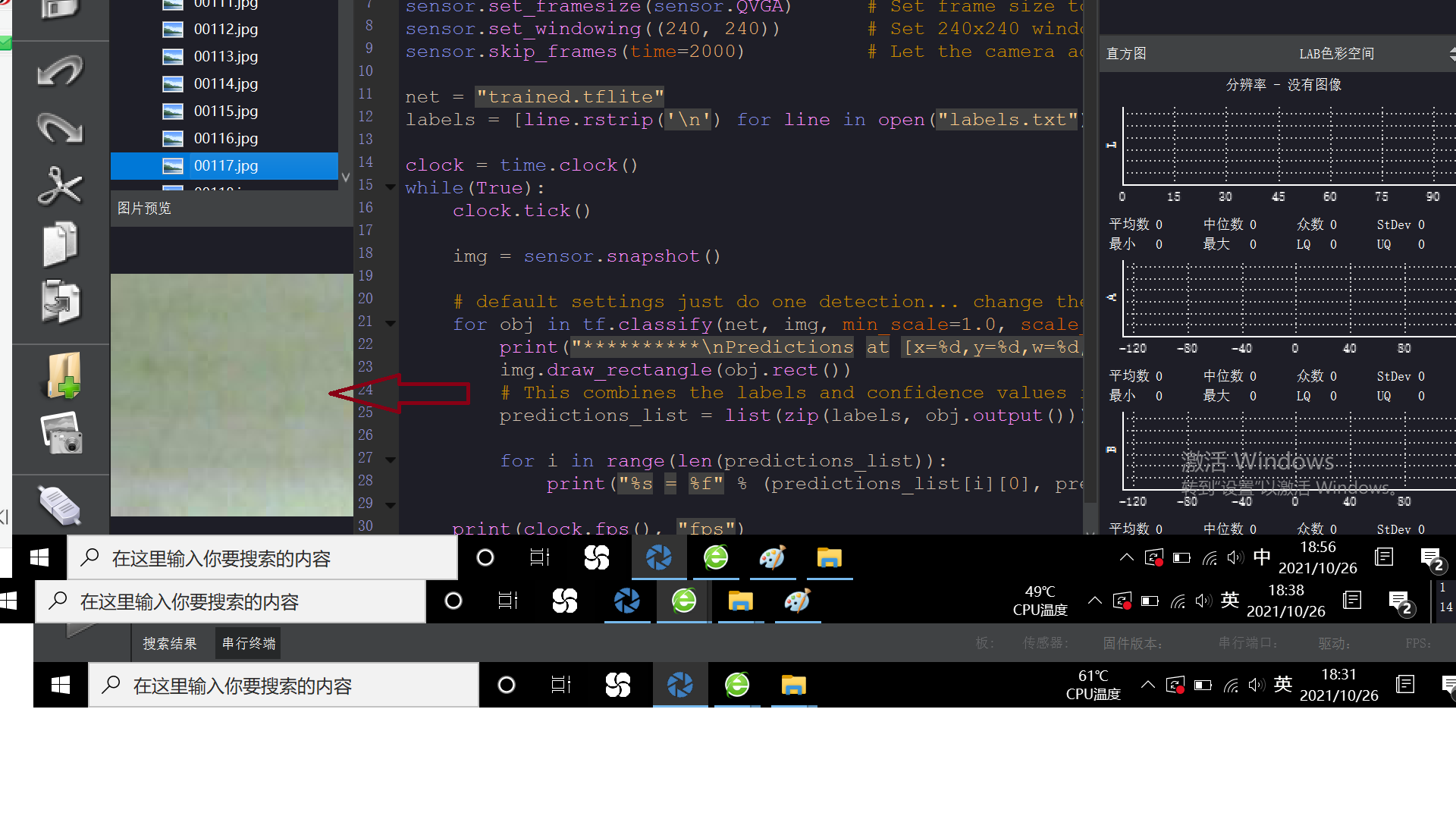

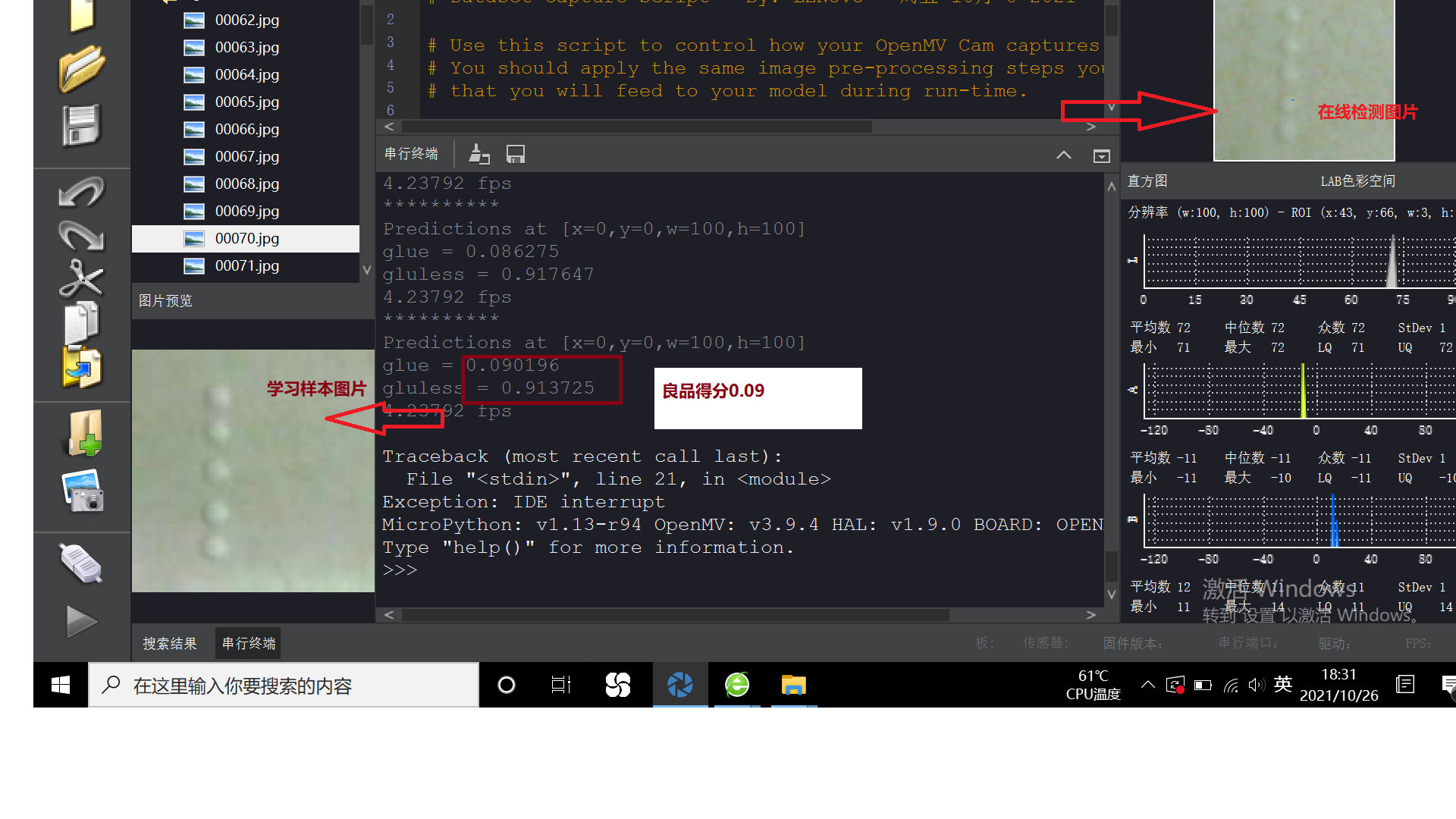

续之前edge impulse 训练结果与实际在线不一致问题的改进,效果不好。发布在 OpenMV Cam

感谢您之前的回复,按照您的建议,有变化的部分在图像中占比不宜太小,故做了调整,采集时候的代码:

原来的:sensor.set_pixformat(sensor.RGB565)

sensor.set_framesize(sensor.QVGA)改为了:sensor.set_pixformat(sensor.RGB565)

sensor.set_framesize(sensor.VGA)

sensor.set_windowing((100,100))

这样一来,有无胶在视野中变化很大,但是依然不行,请看

是不是不能改dataset_capture_py里面的代码?

为什么dataset_capture_py里默认是QVGA

但是edge impulse生成的ei_classification里就自动变成了QVGA的(240,240)? -

昨天Edge impulse 问题继续发布在 OpenMV Cam

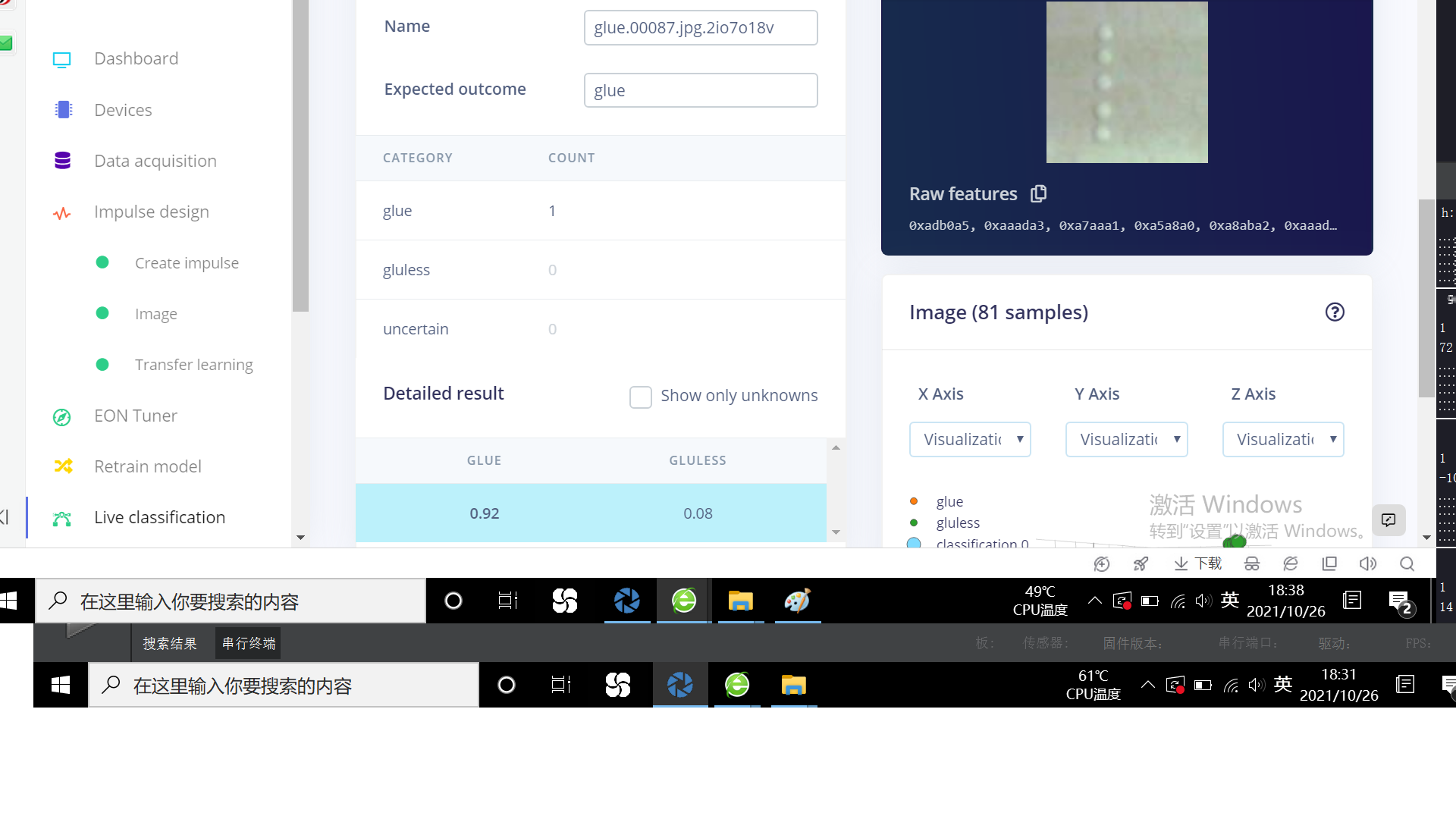

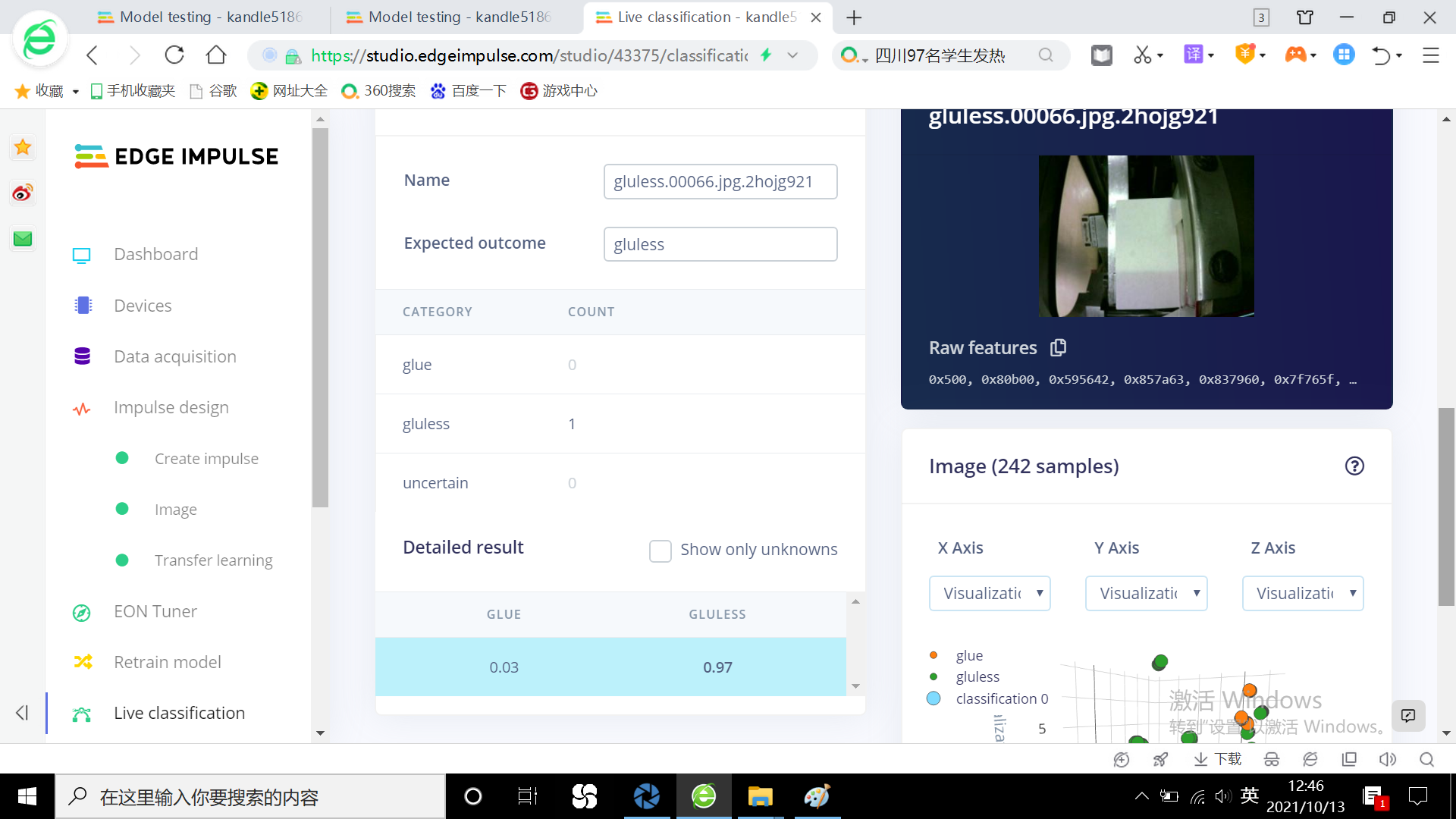

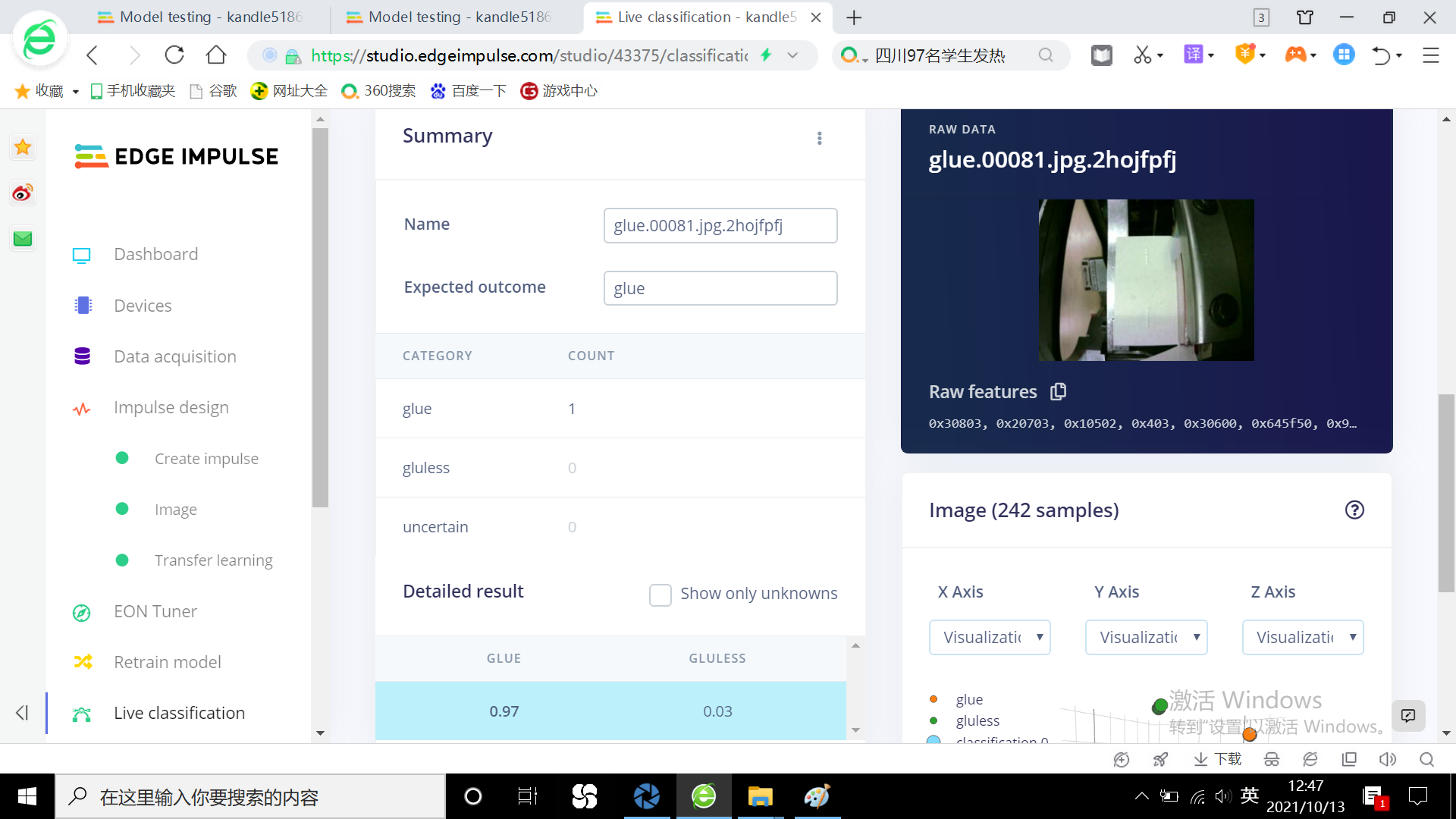

1,良品和次品的区别是有无胶点,这个区别在edge impulse里区别得很完美;

2,您说可能是过拟合了,需要提高dropout的数值?还是其他方法 -

Edge impluse 训练结果与实际测试结果不符发布在 OpenMV Cam

之前问过您,相同的照片,edge impulse 的MODEL testing测试为0.95以上,但是在实际中只有0.1不到的得分,已经采集图片训练50次以上,都这样。

1,model test 100%![0_1634186243995_100%.png]

2,次品

3,良品

4,实际跑代码在线测试,和model test得分95+的一模一样的图片,只有不到10分 -

openmv plus刷固件应该使用哪个文件刷发布在 OpenMV Cam

openmv plus刷固件应该使用哪个文件刷V?. ? . ?,我的是plus,是不是应该下载最新的MiniSTM32H7xx/SDK/openmv/Firmwares/V4.1.0/Internal Flash/openmv.bin,还是别的V?. ? . ?。

问题是这样的,edge impulse上模型验证accuracy已经是100%,但是相同的图片,在ei_xxxxxx_xxxxxxx运行的时候,正确率基本上是0%,之前用的2个都正常,打开U盘发现里面有个temp的文件夹,删不掉,里面是乱码的文件,估计是这个影响,所以想刷固件。

-

edge impulse生成的py文件ei_image_classification是否需要覆盖main.py发布在 OpenMV Cam

在openmv IDE上运行ei_image_classification效果满意之后,是否需要用ei_image_classification是否需要覆盖main.py,以便VIN供电时使用

-

RE: 颜色阈值的选取,除了手动选择,还有openmv自带的 otsu's算法求阈值,openmv里还有其他方法嘛?发布在 OpenMV Cam

那个是假的,最可靠的是LAB,你看右边屏幕下面那个LAB的值才是真的,机器视觉选项里,闸值编辑器是假的,你把需要识别的颜色区域在右边图像里框起来,然后看下面的LAB值范围才准确